mindspore.ops.fast_gelu

- mindspore.ops.fast_gelu(x)[源代码]

快速高斯误差线性单元激活函数。

FastGeLU定义如下:

\[\text{output} = \frac {x} {1 + \exp(-1.702 * \left| x \right|)} * \exp(0.851 * (x - \left| x \right|)),\]其中 \(x\) 是输入元素。

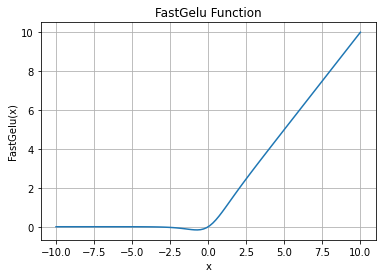

FastGelu函数图:

- 参数:

x (Tensor) - 计算FastGeLU的输入,数据类型为float16或者float32。

- 返回:

Tensor,其shape和数据类型和 x 相同。

- 异常:

TypeError - x 数据类型不是float16或者float32。

- 支持平台:

AscendGPUCPU

样例:

>>> import mindspore >>> import numpy as np >>> from mindspore import Tensor, ops >>> x = Tensor(np.array([[-1.0, 4.0, -8.0], [2.0, -5.0, 9.0]]), mindspore.float32) >>> output = ops.fast_gelu(x) >>> print(output) [[-1.5418735e-01 3.9921875e+00 -9.7473649e-06] [ 1.9375000e+00 -1.0052517e-03 8.9824219e+00]]