mindspore.nn.ReLU

- class mindspore.nn.ReLU[源代码]

修正线性单元激活函数(Rectified Linear Unit activation function)。

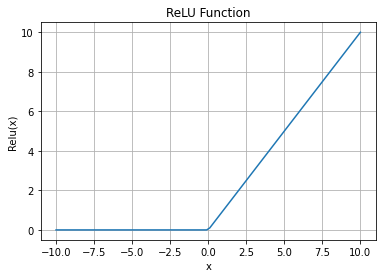

\[\text{ReLU}(x) = (x)^+ = \max(0, x),\]逐元素求 \(\max(0, x)\) 。

说明

负数输出值会被修改为0,正数输出不受影响。

ReLU激活函数图:

- 输入:

x (Tensor) - 用于计算ReLU的任意维度的Tensor。数据类型为 number。

- 输出:

Tensor,数据类型和shape与 x 相同。

- 异常:

TypeError - x 的数据类型不是number。

- 支持平台:

AscendGPUCPU

样例:

>>> import mindspore >>> from mindspore import Tensor, nn >>> import numpy as np >>> x = Tensor(np.array([-1, 2, -3, 2, -1]), mindspore.float16) >>> relu = nn.ReLU() >>> output = relu(x) >>> print(output) [0. 2. 0. 2. 0.]